RAG-решения на рынке: какие бывают и как выбрать подход для бизнеса

В предыдущих статьях мы разобрали, что такое Retrieval-Augmented Generation (RAG) и почему одного LLM недостаточно для корпоративных задач.

Когда AI-ассистент не подключён к внутренним данным, он быстро перестаёт быть полезным: не знает контекст, не может отвечать по документам и часто ошибается.

Поэтому всё больше компаний рассматривают RAG как следующий шаг после внедрения LLM.

Но возникает практический вопрос – какое RAG-решение выбрать?

Рынок быстро растёт, но остаётся фрагментированным. Есть SaaS-инструменты, enterprise-платформы, конструкторы и кастомные архитектуры. Они сильно отличаются по возможностям, стоимости и гибкости.

В этой статье разберём:

- какие типы RAG-решений существуют

- чем они отличаются

- какие подходят для разных задач

- на что обращать внимание при выборе

- почему модульный подход становится базовой архитектурой

Как устроен рынок RAG-решений

Если упростить, большинство решений можно разделить на четыре категории: enterprise-платформы, workplace AI-ассистенты, SaaS-RAG для mid-market, собственные разработки RAG систем.

1. Enterprise-платформы

Это решения уровня крупных организаций, которые строят централизованный поиск и AI-ассистентов поверх внутренних данных.

Обычно такие платформы включают:

- корпоративный поиск

- управление доступами

- интеграции с системами

- масштабируемую инфраструктуру

Они подходят компаниям с большим количеством пользователей и сложной IT-средой. Для крупных организаций это логичный выбор, но для многих компаний такие решения оказываются избыточными. Плюсы и минусы enterprise-платформ:

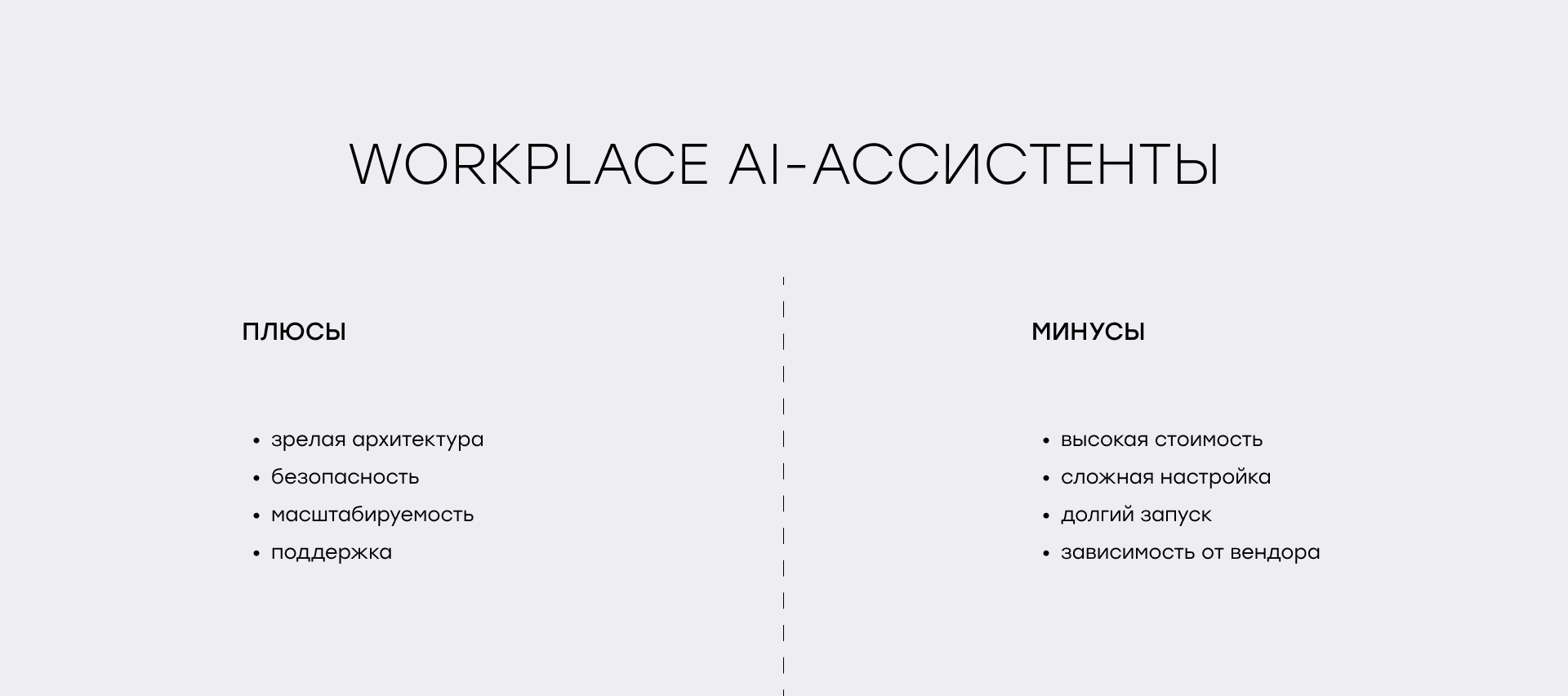

2. Workplace AI-ассистенты

Вторая категория — инструменты для внутреннего поиска знаний и Q&A. Они позволяют сотрудникам задавать вопросы и получать ответы из подключённых источников: документов, wiki, CRM, базы знаний.

Такие решения хорошо подходят для экспериментов и небольших команд, но редко становятся долгосрочной инфраструктурой.

3. SaaS-RAG для mid-market

Существуют платформы, которые позволяют быстро собрать RAG-бота для документации или поддержки.

Обычно они используются для:

- FAQ

- support-ботов

- документации

- внутренних баз знаний

Хорошо подходят для пилотов, но редко используются как долгосрочное решение.

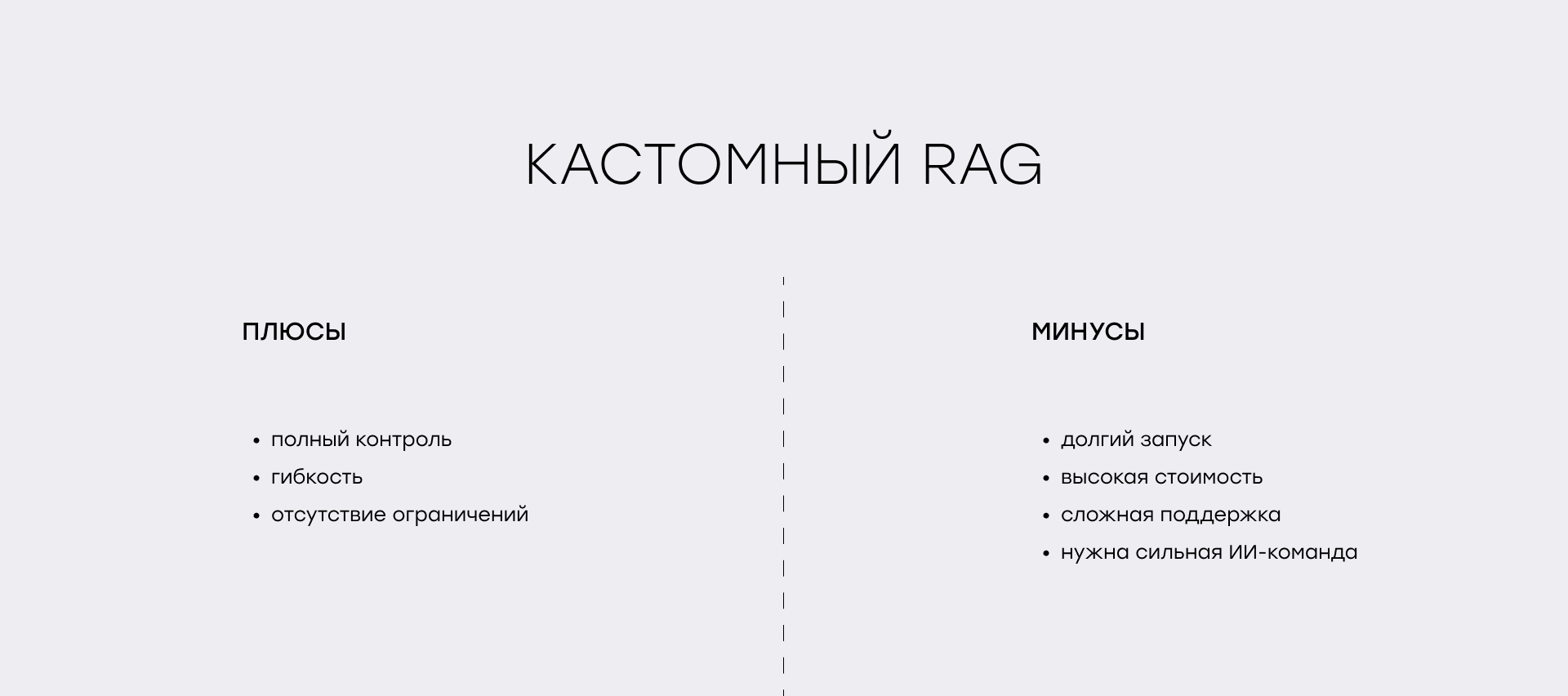

4. Полностью кастомный RAG

Некоторые компании строят RAG полностью самостоятельно.

Это обычно включает:

- LLM

- vector database

- search engine

- ETL-pipeline

- orchestration

Этот подход оправдан, если у компании уже есть собственная ИИ-команда и долгосрочная стратегия.

Почему возникает новый подход?

Что такое модульный RAG?

Модульный RAG — это переиспользуемый, готовый к продакшену AI-фреймворк, который быстро настраивается поверх внутренней базы знаний компании. Вместо разработки системы с нуля или подписки на жёстко ограниченную платформу, организация внедряет модульное решение, адаптированное под её процессы, источники данных и требования безопасности.

После внедрения система может объединить:

- внутренние документы и базы знаний

- PDF-файлы, политики и инструкции

- контракты и комплаенс-материалы

- продуктовую документацию и технические руководства

- таблицы и отчёты

- структурированные базы данных

- графики, схемы и сканы

Сотрудники могут задавать вопросы вроде:

- «Что изменилось в новой политике?»

- «Где находится пункт о расторжении?»

- «Сколько сделок закрыто в прошлом квартале?»

И получать ответы, основанные на реальных данных компании.

Если ответа нет в разрешённых источниках, система прямо сообщает об этом — что снижает вероятность галлюцинаций и повышает доверие к AI.

Модульный RAG сочетает:

- скорость внедрения

- контроль

- гибкость

Этот подход становится всё популярнее среди организаций, которым нужен приватный RAG, корпоративный AI-поиск или кастомный AI-ассистент, обученный на внутренних данных без долгосрочной зависимости от поставщика. Без необходимости строить всё с нуля.

Как выглядит RAG в реальной работе?

Обычно самый быстрый способ оценить RAG — подключить какой-то объем ваших документов и посмотреть, как система отвечает на реальные вопросы сотрудников. Такой пилот позволяет понять точность, ограничения и потенциальный эффект до полноценного внедрения.

Что должно быть в зрелой RAG-системе

Независимо от подхода, современная система обычно включает:

- Гибридный поиск – сочетание векторного поиска, keyword-поиска, фильтрации по метаданным. Это повышает точность ответов.

- Мультимодальные документы – система должна работать не только с текстом, но и с PDF, таблицами, сканами и изображениями, диаграммами.

- Ответы из баз данных – возможность получать ответы из SQL-баз, а не только из документов.

- Контроль доступа – по ролям, разграничение знаний и фильтрацию.

- Аудит и прозрачность – источники ответа, логирование и трассировку.

- Производительность – кэширование и асинхронные пайплайны.

Когда какой подход подходит?

Несмотря на общий интерес к RAG, универсального решения, которое одинаково хорошо подойдёт всем компаниям, не существует.

Выбор архитектуры обычно зависит от объёма данных, требований к безопасности, скорости внедрения и планов по масштабированию.

SaaS-решения

Подходят, если:

- нужен быстрый пилот

- небольшой объём данных

- нет строгих требований

SaaS-решения хорошо работают как стартовая точка, но редко становятся долгосрочной основой для корпоративного RAG.

Enterprise-платформы

Подходят, если:

- тысячи пользователей

- сложная инфраструктура

- централизованный поиск

Подходят крупным организациям, где нужен централизованный поиск по множеству систем и тысячам пользователей, но для многих компаний они оказываются избыточными по масштабу и стоимости.

Кастомное решение

Подходит, если:

- сильная внутренняя команда

- уникальные требования

На практике такой подход выбирают технологические компании или организации с развитой AI-командой, поскольку решения на заказ имеют длительный запуск и необходимость постоянной разработки и поддержки.

Модульный RAG

Подходит, если:

- нужно внедрить быстро

- важен контроль

- планируется масштаб

- нет желания писать всё с нуля

Модульный подход становится наиболее распространённым вариантом для компаний, которые хотят внедрить RAG как рабочий инструмент, а не эксперимент. Обычно такой подход используют компании среднего и крупного размера, которые уже понимают ценность RAG и хотят внедрить его как часть инфраструктуры.

RAG решения, доступные на российском рынке

Западный рынок RAG решений

Западный рынок RAG решений уже перешёл из стадии экспериментов в стадию инфраструктуры. Сегодня можно выделить несколько устойчивых сегментов.

С одной стороны – enterprise-платформы (Azure AI Search + OpenAI, AWS Bedrock, Glean, Coveo), которые предлагают масштабируемую архитектуру, управление доступами и глубокие интеграции, но требуют значительного бюджета и предполагают зависимость от экосистемы вендора.

С другой – SaaS-инструменты для mid-market и workplace-ассистенты (ChatGPT Business, Guru, StackAI и др.), которые позволяют быстро запустить пилот, но ограничены по гибкости, безопасности и работе со сложными документами.

Отдельный сегмент – кастомные RAG-архитектуры на базе open-source и облачных компонентов (LLM + vector DB + search engine + orchestration). Также всё чаще появляется промежуточная модель – модульный RAG: готовая архитектура, которую можно быстро развернуть и адаптировать без полной зависимости от платформы.

Российские решения RAG

Российский рынок находится на более ранней стадии зрелости и имеет другую структуру. Здесь меньше готовых SaaS-продуктов для корпоративного RAG и больше проектных внедрений.

Основными игроками выступают крупные облачные AI-платформы (предоставляющие LLM, embeddings и инструменты для построения RAG) и системные интеграторы, которые реализуют решения под конкретного заказчика. В большинстве случаев RAG внедряется как кастомный или полу-кастомный проект с развёртыванием в инфраструктуре клиента.

Отличительной особенностью рынка является повышенное внимание к контролю над данными, интеграции с внутренними системами и поддержке on-prem или private cloud. Поэтому SaaS-модель используется реже, а архитектуры, которые можно развернуть и адаптировать внутри компании, оказываются более востребованными.

В результате российский рынок естественным образом движется к модульному формату внедрения: не полностью с нуля, но и не чистый SaaS, а управляемая архитектура с возможностью дальнейшего развития. А также присутствуют сильные кастом-интеграторы и LLM-провайдеры.

Особенности российского рынка RAG решений:

- чаще требуется развёртывание в своей инфраструктуре

- меньше готовых SaaS-решений

- выше требования к безопасности

- больше интеграционных проектов

Поэтому многие компании сразу ориентируются на архитектуру, которую можно контролировать и адаптировать.

Enterprise-RAG платформы представленные в России

- Sber AI (GigaChat + RAG) – самый близкий аналог Azure OpenAI stack

- Yandex Cloud AI + Search – аналог Azure AI Search + OpenAI

- VK Cloud + LLM – перспективное и быстро развивающееся Saas-решение

Workplace AI ассистенты представленные в России

- Решение от Just AI – ближайший аналог зарубежных Dust и Guru

- Neuro.net

SaaS-RAG представленные в России

Практически не представлены на нашем рынке. Но есть SaluteBot от Sber solutions и BotHelp AI.

Рынок RAG развивается очень быстро

Несмотря на то, что рынок RAG решений развивается очень быстро, универсального решения, подходящего всем, не существует.

Сегодня можно наблюдать устойчивый тренд:

- RAG становится инфраструктурой

- модульный подход становится стандартом

- компании хотят контроль и гибкость

В ближайшие годы RAG, вероятно, станет базовым слоем корпоративных знаний, так же как когда-то им стал корпоративный поиск.

Попробуйте наше Демо!

Чтобы показать, как RAG выглядит не в теории, а в реальных условиях, мы подготовили интерактивную демонстрацию работы RAG с корпоративными документами.

Практический вывод

RAG постепенно становится не экспериментом, а частью корпоративной инфраструктуры.

Компании внедряют его как слой знаний, который объединяет:

- документы

- базы данных

- отчёты

- инструкции

- внутренние процессы

Такой слой позволяет получать ответы на основе реальных данных.

Практический подход к внедрению

Во многих проектах и сферах бизнеса оптимальный путь выглядит так:

- выбрать один use-case

- подключить реальные данные

- протестировать точность

- масштабировать

Так можно быстро понять ценность RAG и избежать избыточной разработки.

Небольшой практический комментарий

Если вы обдумываете внедрение RAG или приватного AI-поиска, лучший шаг – протестировать систему на ваших данных.

Даже короткий пилот на собственных данных обычно быстро показывает:

- где система даёт ценность

- где требуется настройка

- какие процессы можно ускорить

Именно с такого небольшого теста обычно и начинается внедрение RAG в компаниях. Компании, которые раньше создадут управляемый слой знаний, смогут масштабировать AI быстрее и безопаснее.

Изучитe нашу систему RAG Core 2.0

Мы собрали демонстрационную RAG-систему , которая показывает, как можно объединить корпоративные документы, поиск и генерацию ответов в одном интерфейсе.